それは否定できませんは先進的で、強力で、スマートで、他のどのテクノロジーよりも多くの機能や特性を提供しますが、依然として幻覚を見せたり、誤った情報を共有したりしていることに留意してください。 AI チャットボットは、ユーザーが質問したときに常に答えを共有できるように作られているため、多くの人が検索エンジンの代替としてこのテクノロジーを好むようになりました。

しかし、AIは答えることができますが、質問した人を「裏切らない」ために、幻覚や捏造された情報をユーザーに与えることもありますが、機械ではなく本物のニュースや正当な情報源に依存する時期に来ています。

AI チャットボットは未だに誤った情報やフェイクニュースを幻聴している

AI チャットボットは依然として誤った情報を共有する傾向があり、現代世界における最大の現象の 1 つであることに変わりはありません。これほど高度なチャットボットが質問に答えるために偽のデータや捏造されたデータを作成する傾向があるのはなぜでしょうか?しかし、彼らの幻覚の背後にある本当の理由は、人々が期待しているものとはまったく異なります。特に、チャットボットはマスター、つまり人間を喜ばせたいだけで、手ぶらで戻ってくるのを避けたいだけだと考える人もいるかもしれません。

によるレポートでは、ザ・ヴァージ、現在のような最近のケースでも、AIは依然として幻覚を見せており、一部の著名な人々は、明らかな問題にもかかわらず、ニュースや情報をOpenAIのChatGPTなどに依存しています。 AI はすでにインターネットにアクセスでき、コンテキストを理解したり「推論」を提供したりできる、より高度なモデルを構築中であるにもかかわらず、問題に対する多くの修正や解決策があったとしても、チャットボットは依然として幻覚に逆戻りする可能性があります。

理由はたくさんありますAIソフトウェアが幻覚を起こすこれには、コンテキストの理解の欠如、不適切なプロンプト、更新されたデータへのアクセスの欠如、不十分なトレーニングなどが含まれ、依然として 1 つの答え、つまり不適切なプログラミングにつながります。ユーザーは、特に現在の状態ではまだ幻覚を見る可能性があるため、現時点では AI チャットボットなどの使用に注意する必要があると言えます。

検索エンジンやニュースソースとして AI を使用するのをやめる時が来た

OpenAI や Google などが最新モデルを発表したため、この連休は人工知能にとって大きな節目となるかもしれませんが、こうした進歩にもかかわらず、根本的な問題は依然として存在します。そのため、ユーザーは、特に信頼性が高く、信頼性が高く、安全であるため、人間によって書かれた本物のニュース、特に信頼できる情報源からの本物のニュースに依存する必要があります。

信頼できる出版物からの本物のニュースは依然として研究、正当な情報源、主張を裏付ける証拠に依存していますが、他の Web サイトが AI に依存して記事を作成しているため、依然として警戒を続ける理由があります。

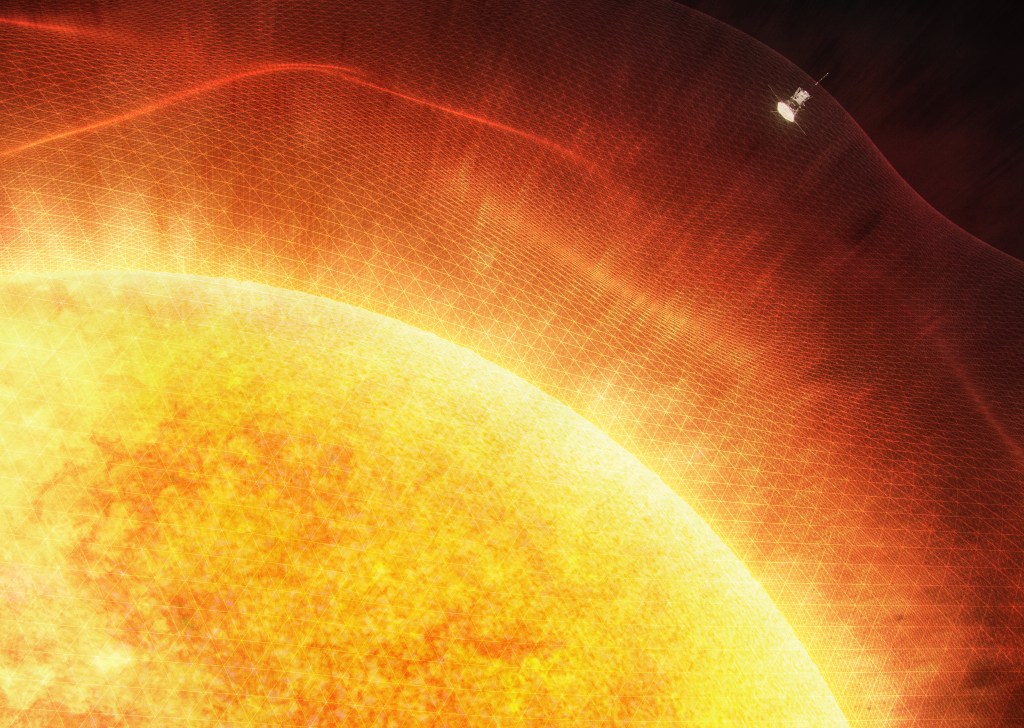

人工知能とその幻覚

OpenAIが取り組んだのは、、このシリーズの他のさらなるプロジェクトと同様に、同社が提示したのは、ユーザーとの「推論」が可能であり、現在の GPT よりもはるかに先進的な AI の進歩でした。 ChatGPT Pro に登録しているユーザーには、それにアクセスする機会が与えられますが、下位層にいるユーザーや無料アクセス権を持つユーザーにも、引き続き GPT-4o が提供されます。

さらに、Google は、一般の人々がアクセスできるように有名なマルチモーダル AI の最新バージョンである Gemini 2.0 もリリースし、同社はまた、これが OpenAI の「推論」モデルに対する答えです。

ただし、これらすべての進歩にもかかわらず、チャットボットの下には応答を間違える可能性があるという注意書きがまだあります。